NIST AI RMF는 미국의 국립표준기술원(NIST)으로 인공지능 시스템의 신뢰성 확보를 위한 리스크 관리 프레임워크를 제공한다. 여기서는 NIST AI 위험관리 프레임워크의 기본 구조와 핵심 개념을 살펴보고, 이를 통해 AI 개발과 운영에서 신뢰할 수 있는 시스템을 구현하는 방안을 분석한다. 또한 현대 사회에서 AI의 확산에 따른 윤리적, 법적, 기술적 리스크를 균형 있게 관리하는 중요성을 확인하며, 실무에서 적용 가능한 리스크 관리 전략을 제시한다. 정식 명칭은 Artificial Intelligence Risk Management Framework (AI RMF 1.0)이다.

NIST AI RMF는 AI 시스템의 리스크를 식별, 평가, 대응하는 체계적 접근법을 제안한다. 이 프레임워크는 “AI 시스템의 신뢰성은 개발 및 운영 전 과정에서 리스크를 체계적으로 관리하는 데 달려 있다”(NIST, 2023, p. 4)고 명시하며, AI가 사회적 가치와 안전 기준을 준수할 수 있도록 하는 것을 목표로 한다. 프레임워크는 크게 준비(Prepare), 식별(Identify), 관리(Manage), 모니터링(Measure), 평가(Govern) 5가지 기능으로 구성되어 있으며, 각 단계는 AI 시스템의 특성과 환경에 맞게 유연하게 적용 가능하도록 설계되었다. 특히, AI의 불확실성과 편향, 데이터 보안, 투명성 문제를 중심으로 리스크를 다룬다.

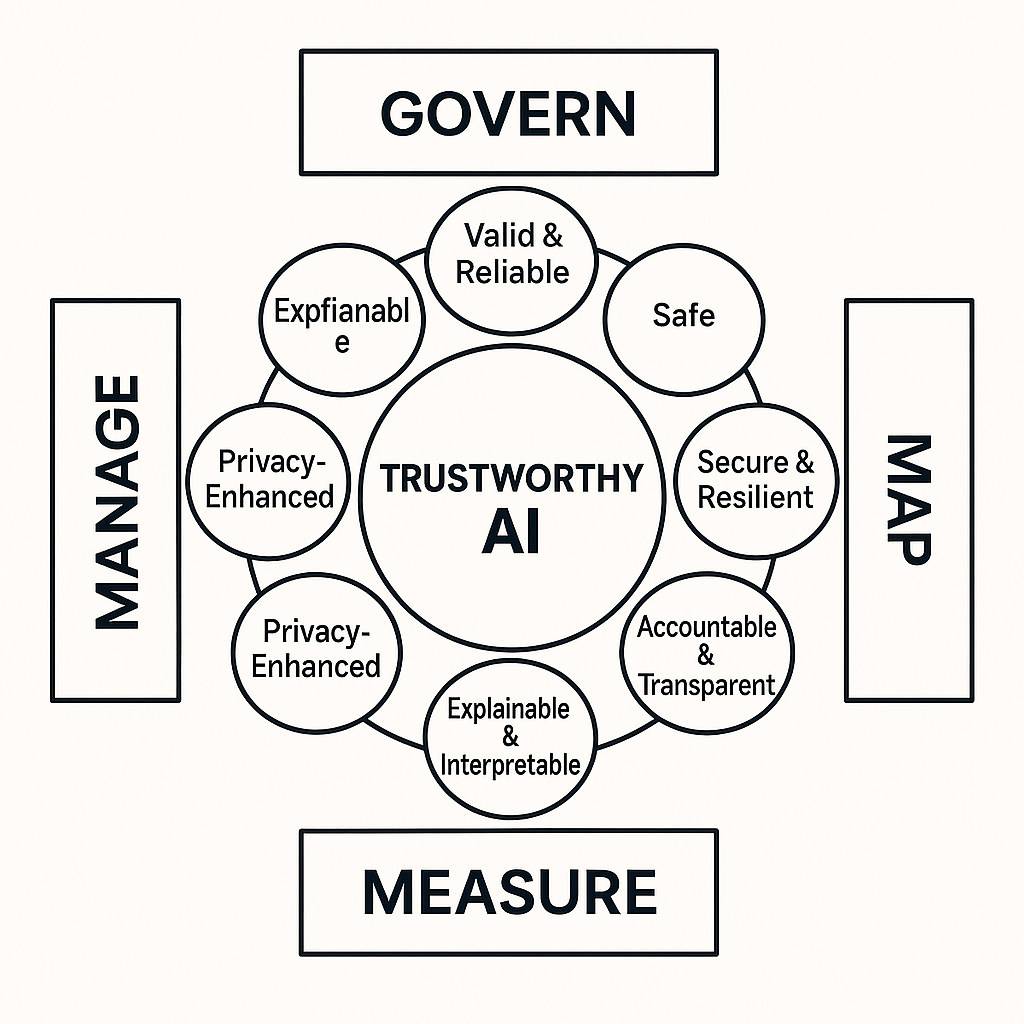

또, NIST AI RMF의 4가지 Core Function은 조직이 신뢰할 수 있는 AI를 위해 리스크를 전 주기에서 관리하도록 하는 절차로, 먼저 GOVERN 단계에서 AI 리스크 관리의 책임·역할·정책·규정과 리스크 허용 수준, 내부 통제·감사 체계 등 거버넌스 기반을 구축하고, MAP 단계에서 대상 AI 시스템의 목적과 이해관계자, 사용 시나리오, 인권·공정성·안전·보안·경제적 피해 등 잠재적 리스크와 라이프사이클별 노출 지점을 구조적으로 파악하며, MEASURE 단계에서 정확도·재현율·공정성·공격 내성·프라이버시 리스크 등 정량·정성 지표와 운영·프로세스·거버넌스 수준을 포함한 KPI를 과학적·법적·윤리적 기준에 따라 측정하고, 마지막으로 MANAGE 단계에서 이 측정 결과를 바탕으로 모델 구조 변경, 데이터 재수집·클린징, 기능 제한, 사람 개입(HITL) 강화, 실시간 모니터링·피드백 루프, 이해관계자 커뮤니케이션 및 사후 대응·교훈 학습 등을 통해 리스크를 수용·회피·완화·전가하는 의사결정을 수행하는 것을 의미한다.

NIST AI RMF는 AI 기술의 급변하는 환경에서 신뢰할 수 있는 AI를 구현하기 위한 실질적 가이드라인을 제공한다. 첫째, 리스크 관리는 단순히 사후 대응이 아니라 AI 시스템의 설계 단계부터 통합되어야 한다. 둘째, AI 시스템의 투명성과 설명 가능성 확보가 필수적이며, 이를 위해 다양한 이해관계자와의 협력이 요구된다. 셋째, AI가 미치는 사회적 영향과 윤리적 고려사항은 기술적 리스크 관리와 병행하여 평가되어야 한다. 넷째, 지속적인 모니터링과 피드백 체계 구축이 리스크 관리를 위한 핵심 요소이다.

현대적인 시사점으로, AI가 다양한 산업과 일상생활에 깊숙이 침투함에 따라 AI 리스크 관리는 단순한 보안이나 성능 이슈를 넘어 사회적 신뢰 구축과 직결된다. 따라서 기업과 기관은 NIST AI RMF와 같은 표준화된 프레임워크를 도입해 AI의 잠재적 위험을 체계적으로 관리하고, 법적 규제 및 윤리 기준을 준수하는 동시에 혁신을 지속해야 한다. 실무적으로는 AI 프로젝트 초기 단계에서 리스크 평가 절차를 명확히 하고, 다양한 전문가와 협력하여 다층적 검증을 수행하는 것이 필요하다.

결론적으로, NIST AI RMF는 신뢰할 수 있는 AI 구축을 위한 실용적 리스크 관리 지침을 제공하며, 다음과 같은 실무 포인트를 제안한다. 첫째, AI 개발 전 과정에 걸쳐 리스크 식별과 평가를 체계적으로 수행해야 한다. 둘째, AI의 설명 가능성과 투명성을 높이기 위한 기술적·관리적 조치를 병행해야 한다. 셋째, AI가 미칠 윤리적·사회적 영향을 고려하여 다각적인 리스크 대응 전략을 마련해야 한다. 넷째, 지속적인 모니터링과 개선 프로세스를 통해 리스크 관리 체계를 유지해야 한다. 다섯째, 다양한 이해관계자와의 협력과 소통을 강화하여 신뢰 구축에 기여해야 한다.

<메모>

NIST AI RMF는 “Trustworthy AI”를 만들기 위해 아래 7가지 신뢰성 특성을 중심에 둠

Valid & Reliable (유효성·신뢰성) 의도한 목적과 조건에서 제대로 작동하고, 일관된 성능을 보이는가?

Safe (안전성) 사람·재산·환경에 예상치 못한 피해를 주지 않도록 설계·운영되는가?

Secure & Resilient (보안·회복탄력성) 공격·오류·환경 변화에 대해 보안상 안전하고, 장애 발생 시 복구 가능한가?

Accountable & Transparent (책임성·투명성) 누가 어떤 의사결정을 했는지 추적 가능하고, 관련 정보가 투명하게 제공되는가?

Explainable & Interpretable (설명가능성·해석가능성) 결과와 그 근거를 사용자가 이해할 수 있게 제공하는가?

Privacy-Enhanced (프라이버시 보호) 데이터 수집·이용·저장 과정에서 프라이버시를 적극적으로 보호하는가?

Fair, with Harmful Bias Managed (공정성·편향 관리) 차별적 결과를 최소화하도록 데이터·모델·출력을 설계·검증하는가?

이 7가지는 서로 독립이 아니라 서로 트레이드오프가 있는 상호 연관된 특성으로, RMF는 이들 간의 균형과 우선순위를 리스크 관점에서 설계하라고 요구함.

AI, N. (2024). Artificial intelligence risk management framework: Generative artificial intelligence profile. NIST Trustworthy and Responsible AI Gaithersburg, MD, USA.

AI, N. (2023). Artificial intelligence risk management framework (AI RMF 1.0). URL: https://nvlpubs. nist. gov/nistpubs/ai/nist. ai, 100-1.

NIST. (2023). AI Risk Management Framework. National Institute of Standards and Technology.

NEOP/X

NEOP/X